Intelligence artificielle et cybersécurité : une arme à double tranchant

Intelligence artificielle et cybersécurité sont désormais indissociables. À mesure que les outils de cybersécurité basés sur l'IA se perfectionnent, ils transforment la façon dont les organisations détectent les menaces, automatisent les réponses et gardent une longueur d'avance sur leurs adversaires. Parallèlement, cela l'évolution rapide introduit de nouveaux défis en matière de sécurité de l'IA, notamment en ce qui concerne les vulnérabilités cachées, les abus et le manque de gouvernance. La double nature de la cybersécurité de l'IA met en évidence à la fois sa puissance et ses risques.

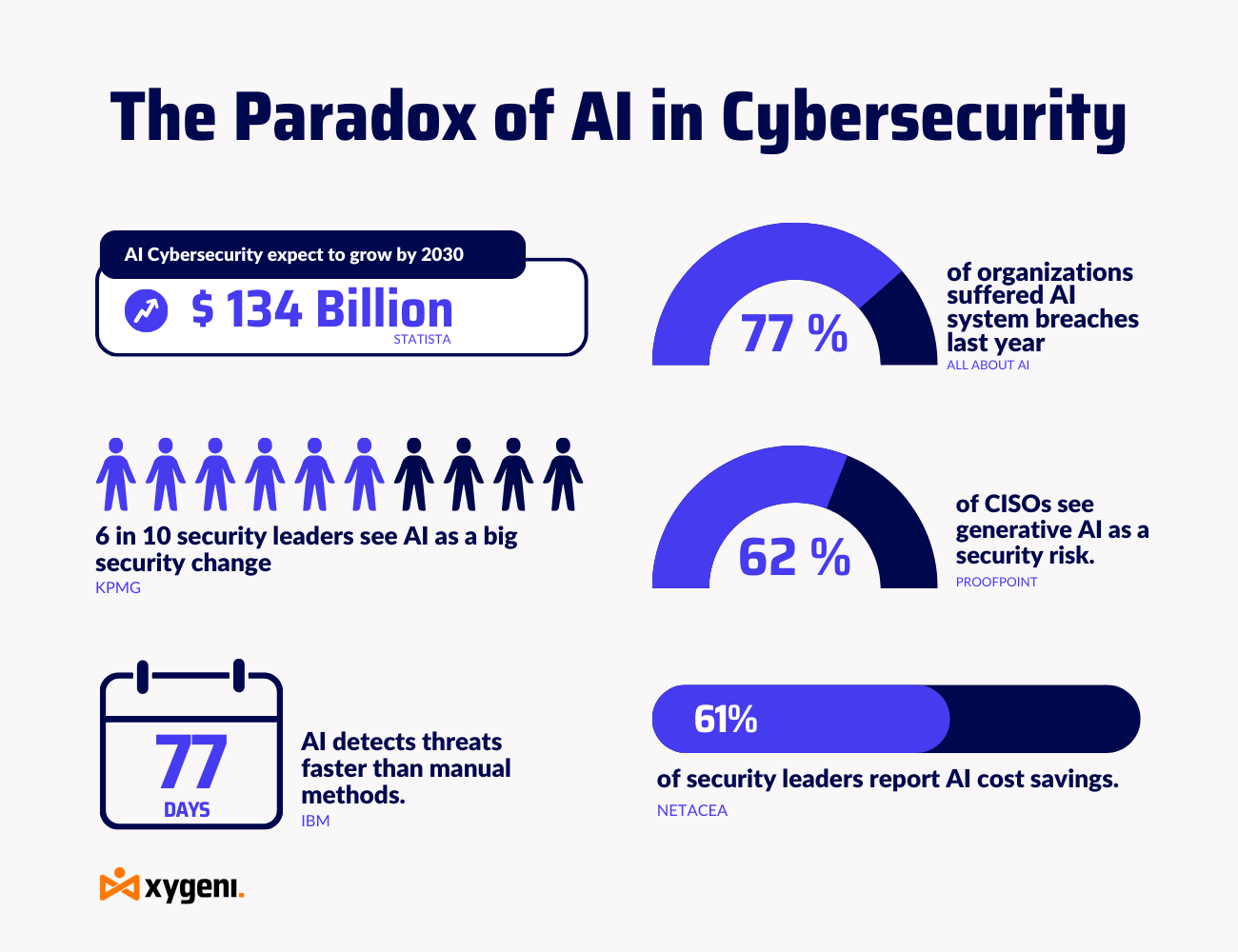

Selon Tout sur l'IA:

77 % des organisations expérimenté des failles dans leurs systèmes d'IA au cours de l’année écoulée, soulignant le besoin urgent de sécuriser l’IA elle-même.

91 % des professionnels de la cybersécurité Ces préoccupé par le fait que l'IA pourrait être utilisé comme arme par des acteurs malveillants.

61% des responsables informatiques identifier l'ombre AI—utilisation non approuvée de l'IA au sein de leur organisation—en tant que problème grandissant.

Plus que 48% de professionnels se sentir confiant dans l'exécution Stratégies de sécurité de l'IA.

Malgré ces risques, L'adoption de l'IA continue de progresser. Le marché mondial de L'IA dans la cybersécurité is devrait se développer de 30 milliards de dollars en 2024 à plus de 134 milliards de dollars d'ici 2030, According To StatesmanCette croissance reflète une réalité fondamentale : la cyberdéfense moderne dépend de plus en plus de l’IA, non seulement pour la détection, mais aussi pour l’automatisation, le renseignement et la rapidité.

Le message est pourtant clair : pour tirer pleinement parti de l’IA en cybersécurité, les organisations doivent la mettre en œuvre de manière responsable, surveiller son comportement et sécuriser les modèles eux-mêmes.

Dans les sections suivantes, nous explorerons :

- Les risques liés à l'utilisation de code généré par l'IA

- Comment les modèles d'IA améliorent la sécurité des applications

- Comment l'IA est utilisée pour la détection des menaces et la priorisation des vulnérabilités

- Et comment l'IA permet une remédiation plus rapide et plus intelligente dans l'ensemble du SDLC

Risques de cybersécurité liés à l'IA dans la génération de code

Alors que les équipes de développement s'appuient de plus en plus sur des outils d'IA génératifs tels que ChatGPT et GitHub Copilot pour écrire du code, il est essentiel d'évaluer les implications de ce changement en matière de cybersécurité de l'IA. Alors que ces outils accélèrent la productivité et réduire les tâches répétitives, ils introduisent également des risques qui peuvent compromettre la sécurité des applications, en particulier lorsqu'elles sont utilisées sans surveillance ou validation appropriée.

Risques cachés derrière le code généré par l'IA

Les outils d'IA apprennent à partir d'énormes quantités de code public, parfois sécurisé, mais souvent obsolète ou risqué. De ce fait, le code qu'ils génèrent peut reproduire d'anciennes erreurs ou manquer des contrôles de sécurité essentiels. Les développeurs sont souvent convaincus que le code généré par l'IA « fonctionne tout simplement », mais cette rapidité peut avoir un prix. Sans une vérification appropriée, une logique erronée peut facilement se retrouver en production.

Les vulnérabilités les plus fréquentes observées dans le code généré par l'IA incluent :

- Secrets et informations d'identification codés en dur : Les outils d’IA peuvent insérer sans le savoir des jetons d’accès ou des mots de passe directement dans le code.

- Validation d'entrée incorrecte : L’absence de désinfection des entrées peut ouvrir la porte à des attaques par injection, notamment SQL et par injection de commandes.

- Configurations non sécurisées : Code d'infrastructure généré (IaC) manque souvent de configurations de sécurité minimales, exposant les systèmes à des erreurs de configuration ou à un accès trop permissif.

- Vérifications d'authentification ou d'autorisation manquantes : L’IA peut générer du code fonctionnel qui ignore la logique de sécurité critique, en particulier dans les itinéraires ou les points de terminaison.

En raison de ces problèmes, Sécurité IA Les équipes et les développeurs doivent rester vigilants. Traitez le code généré par l'IA comme non fiable par défaut, comme toute bibliothèque tierce. Autrement dit, analysez-le, vérifiez-le et appliquez systématiquement des consignes de codage sécurisées. Sinon, un code apparemment propre pourrait devenir une porte d'entrée discrète pour les attaquants.

La sécurité par conception, et non par hypothèse

Ces risques ne sont pas seulement théoriques. Des recherches menées par la communauté de la sécurité au sens large ont montré qu'une part importante du code généré par l'IA contient des bugs exploitables. De plus, les développeurs considérant de plus en plus l'IA comme un assistant de codage, le risque que ces failles soient introduites – et approuvées – sans vérification augmente rapidement.

Pour atténuer ces risques, les organisations doivent :

- Décaler la sécurité vers la gauche en intégrant SAST et SCA outils pour analyser le code généré par l'IA pendant le développement.

- Définir des directives de codage sécurisées pour les équipes utilisant des assistants de codage IA.

- Traiter le code généré par l'IA comme non fiable jusqu’à ce qu’il ait passé des contrôles de sécurité rigoureux, tout comme les composants tiers.

L’IA peut être un outil puissant entre les mains des développeurs, mais sans les bons outils. guardrails, cela pourrait devenir une voie rapide pour l’expédition de logiciels non sécurisés.

Intelligence artificielle et cybersécurité dans AppSec

L'intelligence artificielle transforme la sécurité des applications, non seulement par la génération de code, mais aussi en améliorant la détection et la prévention des vulnérabilités. Les programmes AppSec les plus avant-gardistes s'appuient aujourd'hui sur des modèles d'apprentissage automatique (ML) entraînés sur des données réelles pour identifier les anomalies et les schémas à risque avec une précision inégalée.

Au-delà de la détection basée sur des règles

Les scanners de sécurité traditionnels s'appuient fortement sur des règles et des signatures fixes. Bien qu'efficaces dans une certaine mesure, ils peinent à détecter les nouvelles menaces ou les vulnérabilités contextuelles. C'est là que les modèles d'IA, notamment ceux entraînés par l'apprentissage automatique, offrent un avantage certain.

Utiliser des plateformes comme Étreindre le visageLes développeurs et les équipes de sécurité peuvent créer et affiner des modèles de transformateurs capables de comprendre des schémas de codage complexes, des comportements architecturaux et même les habitudes des développeurs. Ces modèles peuvent :

- Détecter des modèles inhabituels dans le code source ou les fichiers de configuration qui peuvent indiquer des erreurs de configuration ou des vecteurs d'attaque émergents.

- S'adapter aux risques spécifiques à la langue et au framework, apprenant de enterprise-bases de code spécifiques pour réduire les faux positifs.

- Anomalies ponctuelles dans les modèles d'accès ou CI/CD pipeline comportements qui peuvent signaler une intention malveillante ou une dérive politique.

AppSec rencontre l'IA, en interne et en continu

L'intégration de l'IA dans la sécurité des applications ne consiste pas à remplacer les outils existants, mais à les enrichir. Avec le bon modèle, les entreprises peuvent aller au-delà de la détection statique et commencer à apprendre de leur propre environnement, en identifiant les risques propres à leurs applications et workflows.

Certaines équipes utilisent même leurs propres outils de détection d'IA, entraînés sur le code de leur entreprise, pour repérer les problèmes de sécurité récurrents et fournir un meilleur retour aux développeurs. Ce processus d'apprentissage continu permet aux programmes de sécurité de se développer et de s'améliorer au fur et à mesure des évolutions logicielles.

En bref, la détection assistée par l'IA n'est plus de la science-fiction. C'est la nouvelle frontière de la sécurité applicative intelligente et évolutive.

Sécurité de l'IA pour la détection des menaces et la priorisation des vulnérabilités

Face à la complexité croissante des écosystèmes logiciels modernes, le défi ne consiste pas seulement à détecter les vulnérabilités, mais aussi à identifier celles qui sont réellement importantes. Dans le contexte évolutif de l'intelligence artificielle et de la cybersécurité, les modèles basés sur l'IA aident les équipes à dépasser les analyses statiques en offrant une détection et une priorisation des menaces plus intelligentes et contextuelles.

Modèles d'IA qui comprennent le comportement du code

Contrairement aux scanners traditionnels qui s'appuient sur des règles statiques, les moteurs de détection basés sur l'IA analysent le comportement du code, les schémas d'exécution et les relations sémantiques. Ces modèles sont entraînés sur des bases de code volumineuses et des données de menaces réelles, ce qui leur permet de :

- Identifier les vulnérabilités avec plus de précision, même à travers des langages variés ou des structures de code non conventionnelles.

- Détecter la logique malveillante ou des logiciels malveillants intégrés dans des artefacts logiciels susceptibles de contourner les analyses basées sur les signatures.

- Corréler les signaux de risque à partir du code, de la configuration et pipeline activité visant à découvrir des chemins d’attaque complexes.

Cette compréhension plus approfondie permet aux systèmes d’IA de détecter à la fois les failles évidentes et les risques de sécurité subtils qui sont souvent manqués lors des examens manuels ou des analyses automatisées de base.

Contexte de menace et modèles de priorisation de la sécurité de l'IA

Toutes les vulnérabilités ne justifient pas le même niveau de réponse. Les modèles d'IA permettent un tri plus intelligent en prenant en compte :

- Signaux d'exploitabilité (par exemple, exploits publics, exploiter la notation de prédiction).

- Analyse d'accessibilité.

- Profondeur de dépendance et fréquence d'utilisation.

- Contexte d'exécution et variables d'environnement.

Ce faisant, ces systèmes contribuent à réduire la fatigue liée aux alertes et à concentrer l’attention des développeurs là où elle compte : sur les menaces réelles à fort impact.

Apprentissage continu et adaptation

L'un des principaux atouts de l'IA réside dans sa capacité d'apprentissage. À mesure que le paysage des menaces évolue, ces modèles évoluent également, s'adaptant aux nouveaux vecteurs d'attaque, styles de codage et logiques métier. Cela crée une couche de sécurité dynamique qui évolue parallèlement à vos processus de livraison de logiciels.

En fin de compte, l'intelligence artificielle et la cybersécurité ne convergent pas seulement, elles évoluent ensemble. Grâce à la détection intelligente des menaces et à leur priorisation en temps réel, la cybersécurité basée sur l'IA permet une sécurité plus rapide, plus intelligente et plus efficace à grande échelle.

Correction basée sur l'IA : de la détection aux correctifs automatisés

Comment les outils de sécurité de l'IA accélèrent la remédiation

La détection n'est que la première étape. Dans la sécurité des applications modernes, Remédiation pilotée par l'IA remodèle la manière dont les équipes réagissent aux vulnérabilités, en ne se contentant pas de les signaler, mais en proposant des correctifs contextuels et exploitables en temps réel.

Les modèles d'IA formés sur de vastes référentiels de codes sécurisés et non sécurisés sont désormais capables de suggérer des correctifs, remplacement des dépendances vulnérables, Et même générer des mises à jour de configuration sécuriséesCela accélère considérablement le chemin entre la découverte et la résolution, en particulier pour les équipes de développement opérant dans des cycles de publication serrés.

Par exemple, lorsqu'un package vulnérable ou un secret codé en dur est détecté, l'IA peut automatiquement :

- Proposez la mise à niveau ou la correction la plus sûre en fonction du contexte et des données historiques.

- Générer une remédiation pull requests directement dans les systèmes de contrôle de source.

- Guidez les développeurs à travers les étapes de révocation secrète et de remplacement sécurisé.

Améliorer SAST et IaC avec des modèles de sécurité IA

Tests de sécurité des applications statiques (SAST) et L'infrastructure en tant que code (IaC) L'analyse est essentielle à la détection précoce des risques. Grâce aux améliorations apportées par l'IA, ces outils vont encore plus loin :

- Alimenté par l'IA SAST analyse le code avec une compréhension sémantique plus approfondie, réduisant les faux positifs et identifiant les modèles complexes que les règles traditionnelles pourraient manquer.

- Alimenté par l'IA IaC Security détecte les erreurs de configuration non seulement grâce à des règles prédéfinies, mais également en apprenant à partir de millions de modèles de déploiement réels, aidant ainsi les équipes à sécuriser l'infrastructure à grande échelle.

Ces améliorations basées sur l'IA s'alignent parfaitement sur les pratiques de « shift-left » - permettant une sécurité plus précoce et plus intelligentecisLes ions au sein des workflows des développeurs. À mesure que les modèles évoluent, ils joueront un rôle encore plus important dans la priorisation, la correction et même la prévention des risques avant leur mise en production.

Assurer l'avenir de la cybersécurité de l'IA

L'intelligence artificielle et la cybersécurité sont désormais étroitement liées, voire indissociables. Alors que l'IA devient un élément fondamental du développement logiciel et de la défense contre les menaces, les enjeux sont plus importants que jamais. Pourtant, les données révèlent une réalité inquiétante : 77 % des organisations ont subi des violations dans leurs systèmes d'IA l'année dernière, et uniquement 27 % utilisent l'IA et l'automatisation à travers la prévention, la détection, l'enquête et la réponse catégories.

Les risques vont au-delà du code généré par l'IA non sécurisé. Une récente CSET Le rapport met en évidence trois menaces critiques : la sortie de code non sécurisée, les vulnérabilités des modèles eux-mêmes et les effets en aval, comme l'apprentissage de futurs modèles sur des sorties défectueuses. De même, le Forum économique mondial met en garde : Les technologies émergentes comme l'IA générative creuseront l'écart entre les organisations les plus et les moins cyber-résilientes, avec moins de 10 % des dirigeants pensant que l’IA favorisera les défenseurs plutôt que les attaquants.

Malgré les avertissements, la direction est claire : AI dans les services de cybersécurité Ce n’est pas facultatif, c’est essentiel. Mais nous devons le déployer de manière responsable. Cela signifie :

- Intégrer la sécurité à chaque étape de l’adoption de l’IA, du développement au déploiement.

- Numérisation du code généré par l'IA comme n'importe quel composant tiers.

- Permettre des principes de sécurité dès la conception pour les outils d’IA.

- Améliorer la cyber-résilience dans l’ensemble de l’écosystème, et pas seulement au sein des équipes d’élite.

Le chemin à parcourir comporte des risques, mais l'opportunité est immense. Grâce à l'automatisation intelligente, à la détection ciblée des menaces et aux correctifs basés sur l'IA, les équipes de sécurité peuvent enfin suivre le rythme rapide du développement logiciel moderne. Mais la réussite dépendra de la vigilance, de la transparence sur le fonctionnement de l'IA et de l'établissement de règles claires et partagées. Ainsi, la sécurité de l'IA contribue à protéger, et non à endommager, les systèmes sur lesquels nous comptons.