Искусственный интеллект и кибербезопасность: палка о двух концах

Искусственный интеллект и кибербезопасность теперь неразрывно связаны. По мере того, как инструменты кибербезопасности ИИ становятся все более совершенными, они трансформируют то, как организации обнаруживают угрозы, автоматизируют ответы и опережают противников. В то же время, это быстрая эволюция ставит новые задачи в безопасности ИИ — такие как скрытые уязвимости, неправильное использование и отсутствие управления. Двойственная природа кибербезопасности ИИ подчеркивает как ее силу, так и ее риски.

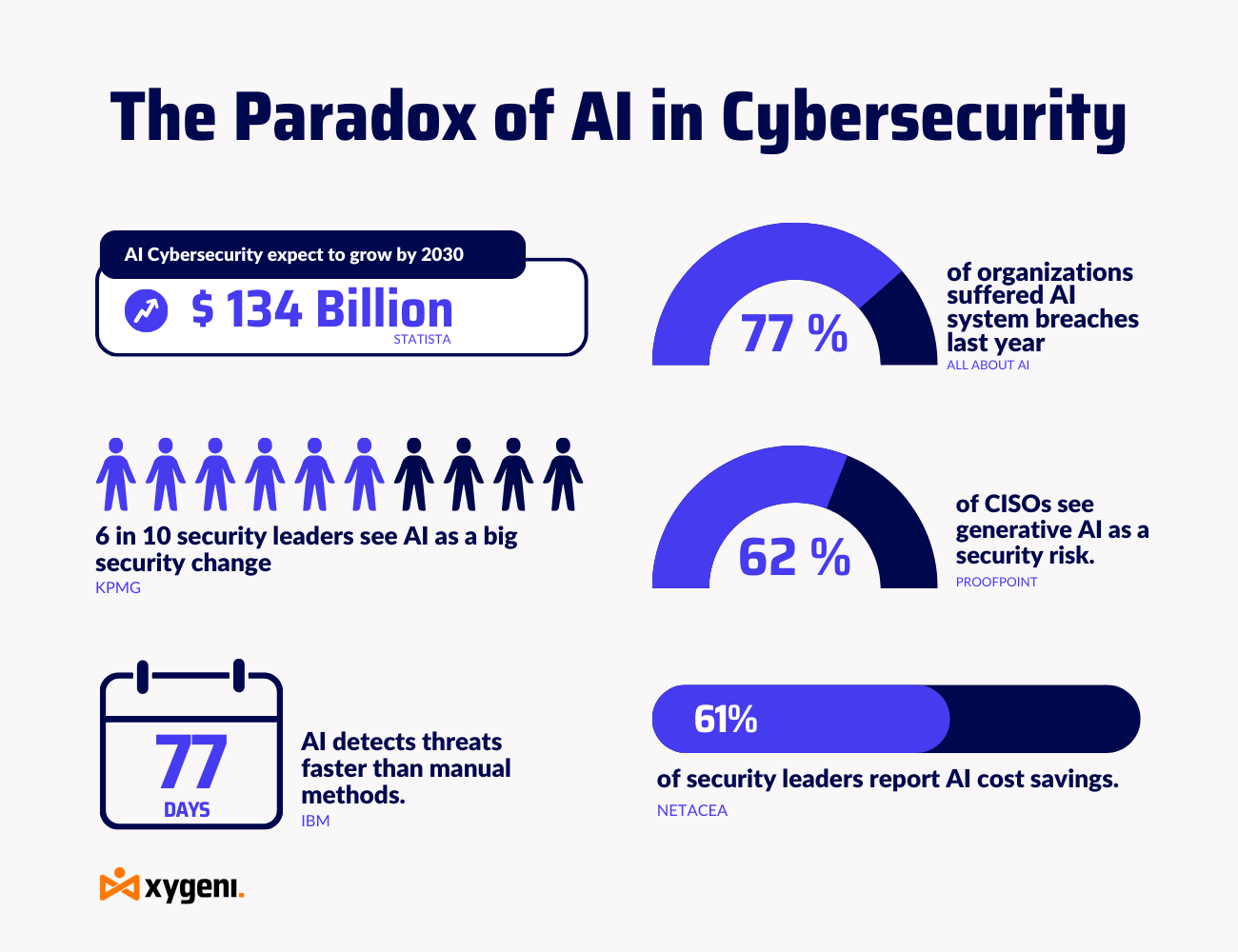

По оценкам Все об ИИ:

77%. организаций опытные нарушения в их системах искусственного интеллекта за последний год, что подчеркивает острую необходимость обеспечения безопасности самого ИИ.

91%. профессионалов в области кибербезопасности обеспокоен тем, что ИИ может быть использовано субъектами угрозы в качестве оружия.

61% ИТ-руководителей определить тень AI—несанкционированное использование ИИ в своей организации—как растущая проблема.

Только приблизительно 48% профессионалов чувствовать себя уверенно в выполнении Стратегии безопасности ИИ.

Несмотря на эти риски, Распространение искусственного интеллекта продолжает растиГлобальный рынок для ИИ в кибербезопасности is ожидается рост с 30 млрд долларов в 2024 году до более 134 млрд. долларов к 2030 году, Согласно StatistaЭтот рост отражает основную реальность: современная киберзащита все больше зависит от ИИ — не только для обнаружения, но и для автоматизации, интеллекта и скорости.

Тем не менее, посыл ясен. Чтобы в полной мере воспользоваться преимуществами ИИ в кибербезопасности, организации должны внедрять его ответственно, контролировать его поведение и защищать сами модели.

В следующих разделах мы рассмотрим:

- Риски использования кода, сгенерированного ИИ

- Как модели ИИ повышают безопасность приложений

- Как ИИ используется для обнаружения угроз и определения приоритетов уязвимостей

- И как ИИ обеспечивает более быстрое и разумное устранение неполадок во всем мире SDLC

Риски кибербезопасности ИИ при генерации кода

Поскольку команды разработчиков все чаще используют для написания кода инструменты генеративного ИИ, такие как ChatGPT и GitHub Copilot, крайне важно оценить последствия этого сдвига для кибербезопасности ИИ. Хотя эти инструменты повышают производительность и сократить повторяющиеся задачи, они также ввести риски которые могут поставить под угрозу безопасность приложения, особенно при использовании без надлежащего контроля или проверки.

Скрытые риски, связанные с кодом, созданным с помощью ИИ

Инструменты ИИ учатся на огромных объемах открытого кода — часть из них безопасна, но большая часть устарела или рискованна. Из-за этого код, который они генерируют, может повторять старые ошибки или пропускать важные проверки безопасности. Разработчики часто верят, что код, сгенерированный ИИ, «просто работает», но эта скорость может стоить дорого. Без надлежащего обзора ошибочная логика может легко попасть в производство.

Наиболее частые уязвимости, обнаруженные в коде, созданном с помощью ИИ, включают в себя:

- Жестко запрограммированные секреты и учетные данные: Инструменты ИИ могут неосознанно вставлять токены доступа или пароли непосредственно в код.

- Неправильная проверка входных данных: Отсутствие очистки входных данных может открыть путь для атак с использованием инъекций, включая SQL-инъекции и инъекции команд.

- Небезопасные конфигурации: Сгенерированный код инфраструктуры (IaC) часто не имеет минимально необходимых конфигураций безопасности, что подвергает системы риску неправильной настройки или чрезмерного разрешительного доступа.

- Отсутствуют проверки аутентификации или авторизации: ИИ может генерировать функциональный код, который пропускает критическую логику безопасности, особенно в маршрутах или конечных точках.

Из-за этих проблем, Безопасность ИИ Команды и разработчики должны сохранять бдительность. Относитесь к коду, сгенерированному ИИ, как к ненадежному по умолчанию — как и к любой сторонней библиотеке. Другими словами, всегда сканируйте его, проверяйте и применяйте безопасные правила кодирования. В противном случае то, что выглядит как чистый код, может оказаться тихой точкой входа для злоумышленников.

Безопасность по замыслу, а не по предположениям

Эти риски не просто теоретические. Исследования более широкого сообщества по безопасности показали, что значительная часть кода, сгенерированного ИИ, содержит эксплуатируемые ошибки. Более того, поскольку разработчики все чаще рассматривают ИИ как помощника по кодированию, риск того, что эти недостатки будут введены — и станут доверенными — без проверки, быстро растет.

Чтобы снизить эти риски, организациям необходимо:

- Сдвиг безопасности влево путем интеграции SAST и SCA инструменты для сканирования кода, сгенерированного ИИ во время разработки.

- Определите правила безопасного кодирования для команд, использующих помощников по кодированию на основе искусственного интеллекта.

- Относиться к коду, сгенерированному ИИ, как к ненадежному пока он не пройдет строгую проверку безопасности — как и сторонние компоненты.

ИИ может быть мощным инструментом в руках разработчиков, но без правильного guardrails, это может стать скоростным маршрутом для распространения небезопасного программного обеспечения.

Искусственный интеллект и кибербезопасность в AppSec

Искусственный интеллект меняет безопасность приложений — не только посредством генерации кода, но и посредством улучшения того, как мы обнаруживаем и предотвращаем уязвимости. Сегодняшние самые передовые программы AppSec используют модели машинного обучения (ML), обученные на реальных данных, чтобы выявлять аномалии и рискованные шаблоны точнее, чем когда-либо прежде.

За пределами обнаружения на основе правил

Традиционные сканеры безопасности в значительной степени полагаются на фиксированные правила и сигнатуры. Хотя они эффективны в определенной степени, они с трудом улавливают новые угрозы или уязвимости, зависящие от контекста. Именно здесь модели ИИ, особенно обученные с помощью машинного обучения, дают явное преимущество.

Использование таких платформ, как Обнимая лицо, разработчики и команды по безопасности могут создавать и настраивать модели трансформаторов, способные понимать сложные шаблоны кодирования, архитектурное поведение и даже привычки разработчиков. Эти модели могут:

- Обнаружение необычных закономерностей в исходном коде или файлах конфигурации, которые могут указывать на неправильные конфигурации или новые векторы атак.

- Адаптируйтесь к рискам, связанным с языком и фреймворком, учиться у enterprise-специфичные кодовые базы для уменьшения ложных срабатываний.

- Аномалии пятна в схемах доступа или CI/CD pipeline поведение, которое может быть признаком злого умысла или отклонения от политики.

AppSec встречает AI — внутренне и непрерывно

Интеграция ИИ в AppSec заключается не в замене существующих инструментов, а в их расширении. С правильной моделью организации могут выйти за рамки статического обнаружения и начать учиться на своей собственной среде, выявляя риски, уникальные для их приложений и рабочих процессов.

Некоторые команды даже используют собственные инструменты обнаружения ИИ, обученные на коде своей компании, чтобы выявлять повторяющиеся проблемы безопасности и давать разработчикам лучшую обратную связь. Этот непрерывный процесс обучения помогает программам безопасности расти и совершенствоваться по мере изменения программного обеспечения.

Короче говоря, обнаружение на базе ИИ — это уже не научная фантастика. Это следующий рубеж для масштабируемой, интеллектуальной безопасности приложений.

Безопасность ИИ для обнаружения угроз и определения приоритетов уязвимостей

По мере того, как современные программные экосистемы становятся все более сложными, задача заключается не только в обнаружении уязвимостей, но и в знании того, какие из них действительно имеют значение. В развивающемся ландшафте искусственного интеллекта и кибербезопасности модели на основе ИИ помогают командам выйти за рамки статического сканирования, предлагая более интеллектуальное, контекстно-зависимое обнаружение угроз и приоритизацию.

Модели ИИ, которые понимают поведение кода

В отличие от традиционных сканеров, которые полагаются на статические правила, механизмы обнаружения на основе ИИ анализируют поведение кода, шаблоны выполнения и семантические связи. Эти модели обучаются на массивных кодовых базах и реальных данных об угрозах, что позволяет им:

- Более точное определение уязвимостей, даже на разных языках или с нетрадиционными структурами кода.

- Обнаружение вредоносной логики или встроенное вредоносное ПО в программные артефакты, которое может обойти сканирование на основе сигнатур.

- Сопоставьте сигналы риска из кода, конфигурации и pipeline деятельность по выявлению сложных путей атак.

Такое более глубокое понимание позволяет системам ИИ выявлять как очевидные недостатки, так и скрытые риски безопасности, которые часто упускаются при ручных проверках или базовых автоматизированных сканированиях.

Контекст угроз и модели приоритетов безопасности ИИ

Не каждая уязвимость заслуживает одинакового уровня реагирования. Модели ИИ поддерживают более разумную сортировку, учитывая:

- Сигналы эксплуатируемости (например, публичные эксплойты, использовать прогнозирование оценки).

- Анализ достижимости.

- Глубина зависимости и частота использования.

- Контекст выполнения и переменные среды.

Благодаря этому данные системы помогают снизить утомляемость от оповещений и сосредоточить внимание разработчиков на самом важном — на реальных угрозах, имеющих большое влияние.

Непрерывное обучение и адаптация

Одно из самых больших преимуществ ИИ — его способность к обучению. По мере развития ландшафтов угроз развиваются и эти модели, адаптируясь к новым векторам атак, стилям кодирования и шаблонам бизнес-логики. Это создает динамический уровень безопасности, который растет вместе с вашими процессами поставки программного обеспечения.

В конечном счете, искусственный интеллект и кибербезопасность не просто сходятся — они развиваются вместе. Благодаря интеллектуальному обнаружению угроз и приоритизации в реальном времени кибербезопасность на основе ИИ обеспечивает более быструю, умную и эффективную защиту в масштабе.

Исправление с помощью ИИ: от обнаружения до автоматизированных исправлений

Как инструменты безопасности на основе ИИ ускоряют устранение неполадок

Обнаружение — это только первый шаг. В современной безопасности приложений Исправление с помощью ИИ меняет то, как команды реагируют на уязвимости — не просто сообщая о них, а предлагая контекстные и действенные исправления в режиме реального времени.

Модели ИИ, обученные на обширных репозиториях безопасного и небезопасного кода, теперь способны предлагая патчи, замена уязвимых зависимостей, И даже создание безопасных обновлений конфигурации. Это значительно ускоряет путь от обнаружения до решения проблемы, особенно для групп разработчиков, работающих в условиях жестких циклов выпуска.

Например, при обнаружении уязвимого пакета или жестко запрограммированного секрета ИИ может автоматически:

- Предложите наиболее безопасное обновление или исправление на основе контекста и исторических данных.

- Создать исправление pull requests непосредственно в системах управления исходным кодом.

- Помогите разработчикам пройти все этапы секретного отзыва и безопасной замены.

Повышение SAST и IaC с моделями безопасности ИИ

Статическое тестирование безопасности приложений (SAST) и Инфраструктура как код (IaC) Сканирование является основой раннего обнаружения рисков. Теперь, с усовершенствованиями ИИ, эти инструменты идут еще дальше:

- на базе искусственного интеллекта SAST анализирует код с более глубоким семантическим пониманием, уменьшая ложные срабатывания и выявляя сложные закономерности, которые традиционные правила могут пропустить.

- на базе искусственного интеллекта IaC Security обнаруживает неправильные конфигурации не только с помощью предопределенных правил, но и путем изучения миллионов реальных шаблонов развертывания, помогая командам защищать инфраструктуру в больших масштабах.

Эти усовершенствования на основе ИИ идеально соответствуют практикам «сдвига влево», обеспечивая более раннюю и интеллектуальную защиту.cisions в рабочих процессах разработчиков. По мере того, как модели продолжают развиваться, они будут играть все большую роль в определении приоритетов, исправлении и даже предотвращении рисков до того, как они попадут в производство.

Обеспечение будущего кибербезопасности ИИ

Искусственный интеллект и кибербезопасность теперь тесно переплетены и неразделимы. Поскольку ИИ становится основополагающей частью разработки программного обеспечения и защиты от угроз, ставки выше, чем когда-либо. Тем не менее, данные рассказывают отрезвляющую историю: 77% организаций столкнулись со взломами своих систем ИИ в прошлом году и Важно 27% используют ИИ и автоматизацию в области профилактики, обнаружения, расследования и реагирования категории.

Риски выходят за рамки небезопасного кода, созданного ИИ. Недавний CSET В отчете выделены три критические области угроз: небезопасный вывод кода, уязвимости в самих моделях и последующие эффекты, такие как обучение будущих моделей на некорректных выводах. Аналогичным образом Всемирный экономический форум предупреждает, что Новые технологии, такие как генеративный ИИ, увеличат разрыв между наиболее и наименее киберустойчивыми организациями., при этом менее 10% лидеров полагают, что ИИ будет отдавать предпочтение защитникам, а не нападающим.

Несмотря на предупреждения, направление ясно: AI в информационной безопасности это не опционально — это необходимо. Но мы должны использовать его ответственно. Это означает:

- Внедрение безопасности на каждом этапе внедрения ИИ — от разработки до развертывания.

- Сканирование кода, сгенерированного ИИ, как и любого стороннего компонента.

- Реализация принципов безопасности при проектировании инструментов ИИ.

- Повышение киберустойчивости во всей экосистеме, а не только в элитных командах.

Дорога впереди сопряжена с некоторыми рисками, но возможности огромны. Используя интеллектуальную автоматизацию, целенаправленное обнаружение угроз и исправления на основе ИИ, команды по безопасности наконец-то смогут идти в ногу с быстрым темпом разработки современного программного обеспечения. Но успех будет зависеть от того, чтобы оставаться бдительными, быть открытыми относительно того, как работает ИИ, и устанавливать четкие общие правила, чтобы безопасность ИИ помогала защищать, а не вредить системам, на которые мы рассчитываем.