الذكاء الاصطناعي والأمن السيبراني: سلاح ذو حدين

الذكاء الاصطناعي والأمن السيبراني أصبحت الآن مترابطة بشكل لا ينفصل. مع تطور أدوات الأمن السيبراني القائمة على الذكاء الاصطناعي، فإنها تُحدث تحولاً في كيفية اكتشاف المؤسسات للتهديدات، وأتمتة استجاباتها، والتفوق على الخصوم. في الوقت نفسه، هذا التطور السريع يطرح تحديات جديدة في أمن الذكاء الاصطناعي، مثل الثغرات الخفية، وسوء الاستخدام، وضعف الحوكمة. تُبرز الطبيعة المزدوجة للأمن السيبراني للذكاء الاصطناعي قوته ومخاطره.

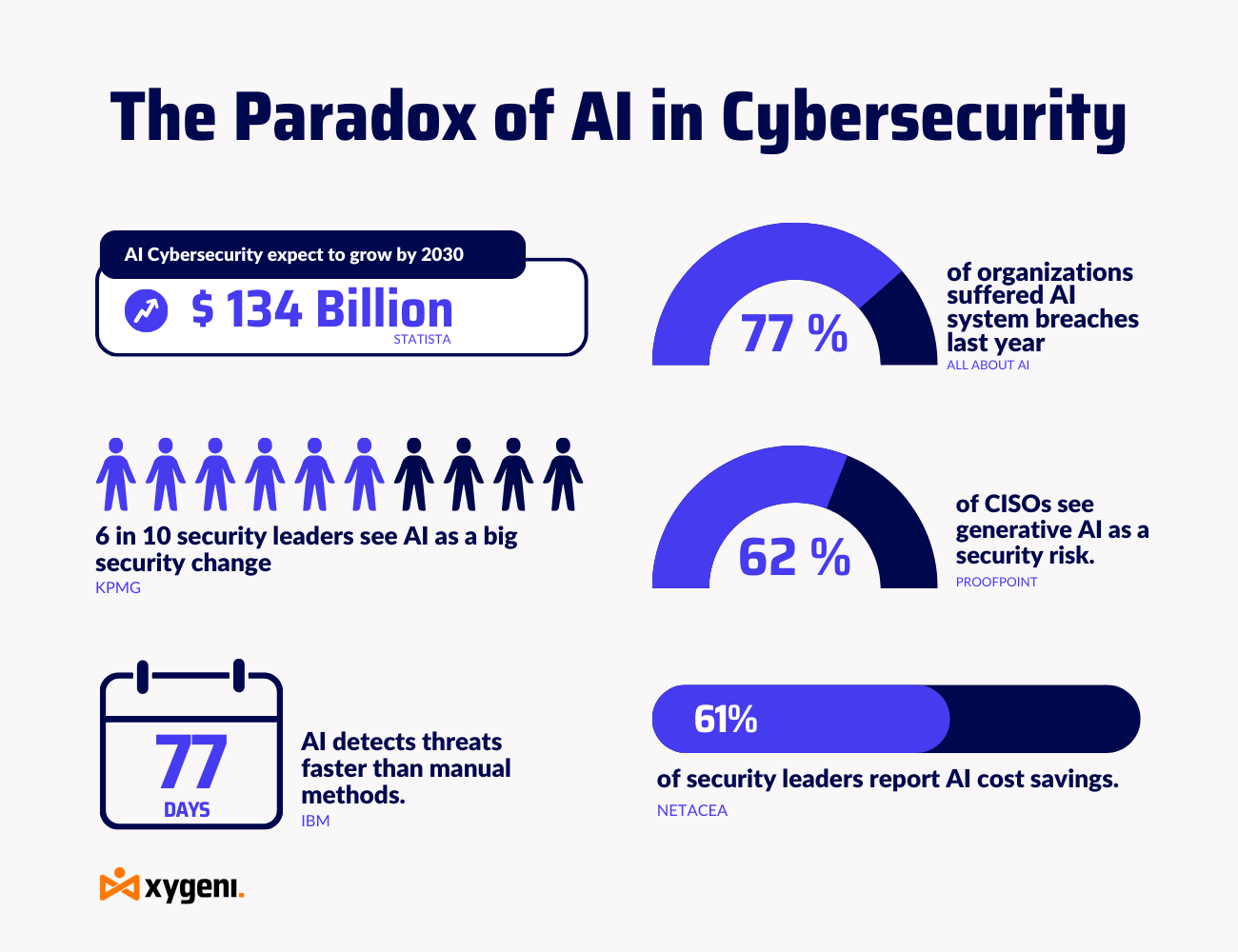

ووفقاً لوكالة كل شيء عن الذكاء الاصطناعي:

77% من المنظمات تمكنت الخروقات في أنظمة الذكاء الاصطناعي الخاصة بهم خلال العام الماضي - مما يسلط الضوء على الحاجة الملحة لتأمين الذكاء الاصطناعي نفسه.

91% من محترفي الأمن السيبراني . قلق بشأن الذكاء الاصطناعي يمكن تسليحها من قبل الجهات الفاعلة المهددة.

61٪ من قادة تكنولوجيا المعلومات تحديد الظل AI- استخدام الذكاء الاصطناعي غير المعتمد داخل مؤسستهم - كـ توليد مشكلة.

فقط 48٪ من المحترفين يشعر بالثقة في التنفيذ استراتيجيات أمن الذكاء الاصطناعي.

على الرغم من هذه المخاطر ، يستمر اعتماد الذكاء الاصطناعي في الارتفاع. السوق العالمية ل الذكاء الاصطناعي في الأمن السيبراني is من المتوقع أن ينمو من 30 مليار دولار في عام 2024 إلى أكثر من 134 مليار دولار بحلول عام 2030، وفقا ل رجل دولةيعكس هذا النمو حقيقة أساسية: تعتمد الدفاعات السيبرانية الحديثة بشكل متزايد على الذكاء الاصطناعي - ليس فقط للكشف، ولكن أيضًا للأتمتة والذكاء والسرعة.

مع ذلك، الرسالة واضحة. للاستفادة الكاملة من الذكاء الاصطناعي في مجال الأمن السيبراني، يجب على المؤسسات تطبيقه بمسؤولية، ومراقبة سلوكه، وتأمين نماذجه بنفسها.

في الأقسام التالية، سوف نستكشف:

- مخاطر استخدام الكود المُولّد بواسطة الذكاء الاصطناعي

- كيف تعمل نماذج الذكاء الاصطناعي على تعزيز أمان التطبيقات

- كيف يتم استخدام الذكاء الاصطناعي للكشف عن التهديدات وتحديد أولويات الثغرات الأمنية

- وكيف يعمل الذكاء الاصطناعي على تمكين المعالجة بشكل أسرع وأكثر ذكاءً في جميع أنحاء SDLC

مخاطر الأمن السيبراني للذكاء الاصطناعي في توليد التعليمات البرمجية

مع اعتماد فرق التطوير بشكل متزايد على أدوات الذكاء الاصطناعي التوليدية مثل ChatGPT وGitHub Copilot لكتابة التعليمات البرمجية، فمن الأهمية بمكان تقييم آثار هذا التحول على الأمن السيبراني للذكاء الاصطناعي. في حين تعمل هذه الأدوات على تسريع الإنتاجية وتقليل المهام المتكررة، كما أنها تقدم مخاطر والتي يمكن أن تعرض أمان التطبيق للخطر، خاصة عند استخدامه دون إشراف أو تحقق مناسب.

المخاطر الخفية وراء الكود المُولّد بالذكاء الاصطناعي

تتعلم أدوات الذكاء الاصطناعي من كميات هائلة من الأكواد البرمجية العامة - بعضها آمن، لكن الكثير منها قديم أو محفوف بالمخاطر. لهذا السبب، قد تُكرر الأكواد البرمجية التي تُنتجها أخطاءً قديمة أو تُغفل فحوصات أمنية أساسية. غالبًا ما يثق المطورون بأن الأكواد البرمجية المُنتجة بواسطة الذكاء الاصطناعي "تعمل بكفاءة"، لكن هذه السرعة قد تكون لها تكلفة. فبدون مراجعة دقيقة، قد يتسلل المنطق الخاطئ بسهولة إلى الإنتاج.

تتضمن الثغرات الأمنية الأكثر شيوعًا التي تم رصدها في التعليمات البرمجية التي تم إنشاؤها بواسطة الذكاء الاصطناعي ما يلي:

- الأسرار وبيانات الاعتماد المبرمجة: قد تقوم أدوات الذكاء الاصطناعي عن غير قصد بإدراج رموز الوصول أو كلمات المرور مباشرة في الكود.

- التحقق غير الصحيح من الإدخال: قد يؤدي عدم تطهير المدخلات إلى فتح الباب أمام هجمات الحقن، بما في ذلك حقن SQL والأوامر.

- التكوينات غير الآمنة: كود البنية التحتية المولد (IaC) غالبًا ما تفتقر إلى تكوينات الأمان الدنيا، مما يعرض الأنظمة لتكوينات خاطئة أو وصول مفرط.

- عمليات التحقق من المصادقة أو الترخيص المفقودة: قد تقوم الذكاء الاصطناعي بإنشاء كود وظيفي يتخطى منطق الأمان الحرج، وخاصة في الطرق أو نقاط النهاية.

وبسبب هذه القضايا، أمن الذكاء الاصطناعي يجب على الفرق والمطورين على حد سواء توخي الحذر. تعامل مع الكود المُولّد بالذكاء الاصطناعي على أنه غير موثوق به افتراضيًا - تمامًا مثل أي مكتبة تابعة لجهة خارجية. بمعنى آخر، افحصه دائمًا، وتحقق منه، وطبّق إرشادات الترميز الآمنة. وإلا، فإن الكود الذي يبدو نظيفًا قد يصبح في النهاية نقطة دخول آمنة للمهاجمين.

الأمن من خلال التصميم، وليس من خلال الافتراض

هذه المخاطر ليست نظرية فحسب. فقد أظهرت أبحاثٌ من مجتمع الأمن الأوسع أن نسبةً كبيرةً من الأكواد البرمجية المُولّدة بالذكاء الاصطناعي تحتوي على ثغراتٍ قابلةٍ للاستغلال. علاوةً على ذلك، ومع تزايد تعامل المطورين مع الذكاء الاصطناعي كمساعدٍ للبرمجة، يتزايد خطرُ إدخال هذه العيوب - والثقة بها - دون مراجعةٍ سريعة.

لتخفيف هذه المخاطر، تحتاج المنظمات إلى:

- تحول الأمن إلى اليسار من خلال الدمج SAST و SCA أدوات لمسح الكود الذي تم إنشاؤه بواسطة الذكاء الاصطناعي أثناء التطوير.

- تحديد إرشادات الترميز الآمن للفرق التي تستخدم مساعدي الترميز بالذكاء الاصطناعي.

- التعامل مع الكود الناتج عن الذكاء الاصطناعي على أنه غير موثوق به حتى يتم اجتيازه من خلال فحوصات أمنية صارمة - تمامًا مثل مكونات الطرف الثالث.

يمكن أن يكون الذكاء الاصطناعي أداة قوية في أيدي المطورين - ولكن بدون الحق guardrailsقد يصبح مسارًا سريعًا لشحن البرامج غير الآمنة.

الذكاء الاصطناعي والأمن السيبراني في AppSec

يُعيد الذكاء الاصطناعي صياغة أمن التطبيقات، ليس فقط من خلال توليد الأكواد البرمجية، بل أيضًا من خلال تحسين كيفية اكتشاف الثغرات الأمنية ومنعها. وتستفيد برامج AppSec الأكثر استشرافًا للمستقبل اليوم من نماذج التعلم الآلي المُدرَّبة على بيانات واقعية لتحديد الشذوذ والأنماط الخطرة بدقة أكبر من أي وقت مضى.

ما وراء الكشف القائم على القواعد

تعتمد أدوات فحص الأمن التقليدية بشكل كبير على قواعد وتوقيعات ثابتة. ورغم فعاليتها إلى حد ما، إلا أنها تواجه صعوبة في اكتشاف التهديدات الجديدة أو الثغرات الأمنية المرتبطة بسياقات محددة. وهنا تبرز ميزة واضحة لنماذج الذكاء الاصطناعي، وخاصة تلك المُدربة من خلال التعلم الآلي.

باستخدام منصات مثل وجه يعانقيمكن للمطورين وفرق الأمن بناء نماذج محولات وضبطها بدقة، قادرة على فهم أنماط الترميز المعقدة، والسلوكيات المعمارية، وحتى عادات المطورين. هذه النماذج قادرة على:

- اكتشاف الأنماط غير العادية في ملفات المصدر أو ملفات التكوين التي قد تشير إلى تكوينات خاطئة أو متجهات هجوم ناشئة.

- التكيف مع المخاطر الخاصة باللغة والإطار، التعلم من enterprise- قواعد بيانات محددة لتقليل الإيجابيات الخاطئة.

- شذوذ البقع في أنماط الوصول أو CI/CD pipeline السلوكيات التي قد تشير إلى نية خبيثة أو انحراف عن السياسة.

AppSec يلتقي بالذكاء الاصطناعي - داخليًا ومستمرًا

دمج الذكاء الاصطناعي في أمان التطبيقات لا يعني استبدال الأدوات الحالية، بل تعزيزها. باتباع النموذج المناسب، تستطيع المؤسسات تجاوز مرحلة الكشف الثابت والبدء بالتعلم من بيئتها الخاصة، وتحديد المخاطر الفريدة لتطبيقاتها وسير عملها.

حتى أن بعض الفرق تستخدم أدوات كشف الذكاء الاصطناعي الخاصة بها، المُدربة على شيفرة شركتها، لاكتشاف الثغرات الأمنية المتكررة وتقديم ملاحظات أفضل للمطورين. تساعد عملية التعلم المستمرة هذه برامج الأمن على النمو والتطور مع تطور البرنامج.

باختصار، لم يعد الكشف المدعوم بالذكاء الاصطناعي ضربًا من الخيال العلمي. إنه آفاق جديدة لأمن التطبيقات الذكي القابل للتطوير.

أمان الذكاء الاصطناعي للكشف عن التهديدات وتحديد أولويات الثغرات الأمنية

مع تزايد تعقيد أنظمة البرمجيات الحديثة، لا يقتصر التحدي على اكتشاف الثغرات الأمنية فحسب، بل يكمن في تحديد أهمها. في ظل التطور المتسارع للذكاء الاصطناعي والأمن السيبراني، تساعد النماذج المعتمدة على الذكاء الاصطناعي الفرق على تجاوز عمليات المسح الثابتة من خلال توفير أساليب أكثر ذكاءً ووعيًا بالسياق للكشف عن التهديدات وتحديد أولوياتها.

نماذج الذكاء الاصطناعي التي تفهم سلوك الكود

بخلاف الماسحات الضوئية التقليدية التي تعتمد على قواعد ثابتة، تُحلل محركات الكشف المُعززة بالذكاء الاصطناعي سلوك الكود وأنماط التنفيذ والعلاقات الدلالية. تُدرّب هذه النماذج على قواعد بيانات ضخمة وبيانات تهديدات واقعية، مما يُمكّنها من:

- تحديد نقاط الضعف بشكل أكثر دقة، حتى عبر اللغات المتنوعة أو هياكل التعليمات البرمجية غير التقليدية.

- كشف المنطق الخبيث أو البرامج الضارة المضمنة في القطع الأثرية البرمجية التي قد تتجاوز عمليات الفحص القائمة على التوقيع.

- ربط إشارات المخاطر من الكود والتكوين و pipeline نشاط لكشف مسارات الهجوم المعقدة.

يتيح هذا الفهم العميق لأنظمة الذكاء الاصطناعي اكتشاف العيوب الواضحة ومخاطر الأمن الدقيقة التي غالبًا ما يتم تجاهلها أثناء المراجعات اليدوية أو عمليات الفحص الآلية الأساسية.

سياق التهديد ونماذج تحديد أولويات أمن الذكاء الاصطناعي

لا تستحق كل ثغرة نفس مستوى الاستجابة. تدعم نماذج الذكاء الاصطناعي فرزًا أكثر ذكاءً من خلال مراعاة:

- إشارات الاستغلال (على سبيل المثال، الاستغلالات العامة، استغلال تسجيل التنبؤات).

- تحليل إمكانية الوصول.

- عمق التبعية وتكرار الاستخدام.

- متغيرات سياق التشغيل والبيئة.

ومن خلال القيام بذلك، تساعد هذه الأنظمة على تقليل إجهاد التنبيهات وتركيز انتباه المطورين حيث يكون ذلك ضروريًا - على التهديدات الحقيقية ذات التأثير العالي.

التعلم المستمر والتكيف

من أهم مزايا الذكاء الاصطناعي قدرته على التعلم. فمع تطور بيئات التهديدات، تتطور هذه النماذج أيضًا، متكيفةً مع متجهات الهجوم الجديدة، وأساليب الترميز، وأنماط منطق الأعمال. وهذا يُنشئ طبقة أمان ديناميكية تتطور مع تطور عمليات تسليم برامجك.

في نهاية المطاف، لا يقتصر التقارب بين الذكاء الاصطناعي والأمن السيبراني على التطور فحسب، بل يتطوران معًا. بفضل الكشف الذكي عن التهديدات وتحديد الأولويات في الوقت الفعلي، يُمكّن الأمن السيبراني القائم على الذكاء الاصطناعي من تحقيق أمن أسرع وأذكى وأكثر كفاءة على نطاق واسع.

الإصلاح المدعوم بالذكاء الاصطناعي: من الاكتشاف إلى الإصلاحات الآلية

كيف تُسرّع أدوات أمان الذكاء الاصطناعي عملية الإصلاح

الكشف ليس سوى الخطوة الأولى. في أمن التطبيقات الحديثة، الإصلاح القائم على الذكاء الاصطناعي إعادة تشكيل كيفية استجابة الفرق للثغرات الأمنية - ليس فقط من خلال الإشارة إليها، ولكن أيضًا من خلال تقديم إصلاحات سياقية قابلة للتنفيذ في الوقت الفعلي.

أصبحت نماذج الذكاء الاصطناعي المدربة على مستودعات ضخمة من التعليمات البرمجية الآمنة وغير الآمنة قادرة الآن على اقتراح التصحيحات, استبدال التبعيات الضعيفة، وحتى إنشاء تحديثات التكوين الآمنةيؤدي هذا إلى تسريع المسار بشكل كبير من الاكتشاف إلى الحل - خاصة بالنسبة لفرق التطوير التي تعمل في ظل دورات إصدار ضيقة.

على سبيل المثال، عندما يتم اكتشاف حزمة ضعيفة أو سر مبرمج، يمكن للذكاء الاصطناعي أن يقوم تلقائيًا بما يلي:

- اقترح الترقية أو الإصلاح الأكثر أمانًا استنادًا إلى السياق والبيانات التاريخية.

- توليد المعالجة pull requests مباشرة في أنظمة التحكم في المصدر.

- توجيه المطورين من خلال خطوات الإلغاء السرية والاستبدال الآمن.

تعزيز SAST و IaC مع نماذج أمان الذكاء الاصطناعي

اختبار أمان التطبيقات الثابتة (SAST) و البنية التحتية كرمز (IaC) يُعدّ المسح الضوئي أساسيًا للكشف المبكر عن المخاطر. والآن، مع تحسينات الذكاء الاصطناعي، تتخطى هذه الأدوات حدود المألوف:

- مدعوم بالذكاء الاصطناعي SAST يقوم بتحليل الكود بفهم دلالي أعمق، مما يقلل من الإيجابيات الخاطئة ويحدد الأنماط المعقدة التي قد تفوتها القواعد التقليدية.

- مدعوم بالذكاء الاصطناعي IaC Security يكتشف التكوينات الخاطئة ليس فقط من خلال القواعد المحددة مسبقًا ولكن من خلال التعلم من ملايين قوالب النشر في العالم الحقيقي، مما يساعد الفرق على تأمين البنية الأساسية على نطاق واسع.

تتوافق هذه التحسينات القائمة على الذكاء الاصطناعي بشكل مثالي مع ممارسات "التحول إلى اليسار" - مما يتيح إمكانية الوصول إلى حلول أمنية أكثر ذكاءً في وقت مبكر.cisمع استمرار تطور النماذج، ستلعب دورًا أكبر في تحديد الأولويات، وإصلاحها، وحتى منع المخاطر قبل وصولها إلى مرحلة الإنتاج.

تأمين مستقبل الذكاء الاصطناعي والأمن السيبراني

أصبح الذكاء الاصطناعي والأمن السيبراني الآن مترابطين بشدة، ولا ينفصلان. ومع تحول الذكاء الاصطناعي إلى جزء أساسي من تطوير البرمجيات والدفاع ضد التهديدات، أصبحت المخاطر أكبر من أي وقت مضى. ومع ذلك، تروي البيانات قصة صادمة: 77% من المؤسسات تعرضت لاختراقات في أنظمة الذكاء الاصطناعي الخاصة بها العام الماضي ، و فقط 27% يستخدمون الذكاء الاصطناعي والأتمتة عبر الوقاية والكشف والتحقيق والاستجابة الفئات.

تتجاوز المخاطر الكود غير الآمن الذي تم إنشاؤه بواسطة الذكاء الاصطناعي. CSET يُسلّط التقرير الضوء على ثلاثة مجالات تهديد حرجة: مخرجات الكود غير الآمنة، وثغرات في النماذج نفسها، والآثار اللاحقة مثل تدريب النماذج المستقبلية على مخرجات معيبة. وبالمثل، يُحذّر المنتدى الاقتصادي العالمي من أن ستؤدي التقنيات الناشئة مثل الذكاء الاصطناعي التوليدي إلى توسيع الفجوة بين المنظمات الأكثر والأقل قدرة على الصمود في مواجهة التهديدات السيبرانية.، حيث يعتقد أقل من 10% من القادة أن الذكاء الاصطناعي سوف يفضل المدافعين على المهاجمين.

وعلى الرغم من التحذيرات، فإن الاتجاه واضح: منظمة العفو الدولية في الأمن السيبراني ليس اختياريًا، بل ضروريًا. لكن يجب علينا استخدامها بمسؤولية. هذا يعني:

- دمج الأمان في كل مرحلة من مراحل اعتماد الذكاء الاصطناعي، من التطوير إلى النشر.

- مسح الكود الذي تم إنشاؤه بواسطة الذكاء الاصطناعي مثل أي مكون تابع لجهة خارجية.

- تمكين مبادئ الأمان من خلال التصميم لأدوات الذكاء الاصطناعي.

- تعزيز المرونة السيبرانية عبر النظام البيئي - وليس فقط داخل الفرق النخبة.

الطريق أمامنا يحمل بعض المخاطر، لكن الفرصة هائلة. باستخدام الأتمتة الذكية، والكشف المُركّز عن التهديدات، والحلول المُعتمدة على الذكاء الاصطناعي، يُمكن لفرق الأمن مُواكبة الوتيرة السريعة لتطوير البرمجيات الحديثة. لكن النجاح يعتمد على البقاء مُتيقظين، والانفتاح بشأن كيفية عمل الذكاء الاصطناعي، ووضع قواعد واضحة ومُشتركة، حتى يُساعد أمن الذكاء الاصطناعي في حماية الأنظمة التي نعتمد عليها، لا في إلحاق الضرر بها.